Een groep techleiders schreef een nieuwe alarmerende statement. Hun waarschuwing liegt er niet om, maar de meningen verschillen.

22 woorden, waarin gewaarschuwd wordt voor uitsterven

Al eerder waarschuwden grootheden uit de AI-wereld, waaronder Elon Musk, in een open brief voor de gevaren van kunstmatige intelligentie, en riepen op tot een tijdelijk moratorium. Zij richtten zich vooral op de mogelijkheid dat kunstmatige intelligentie slimmer dan de mens zal worden en hiermee onvoorspelbaar. Zij maakten zich zorgen om de mogelijkheid dat AI eigen doeleinden na zal streven.

In een nieuw statement, deelden techleiders deze zorgen. Deze keer onder de ondertekenaars niemand minder dan Sam Altman, directeur van OpenAI. Dat is de firma achter ChatGPT. In deze oproep wordt Altman vergezeld door Demis Hassabis, de CEO van Google DeepMind (ontwikkelaar van TensorFlow, wat onder meer de grondslag vormt voor CHatGPT) en de vooraanstaande AI-onderzoekers Geoffrey Hinton en Stuart Russell.

Opvallende afwezigen zijn (tot nu toe) Elon Musk en CEO’s van andere grote bedrijven die volop met AI bezig zijn, zoals Meta (was Facebook) en Apple.

Het statement telt slechts 22 woorden en luidt voluit: “Mitigating the risk of extinction from AI should be a global priority alongside other societal-scale risks such as pandemics and nuclear war”. Vrij vertaald in het Nederlands is dit:

Voorkomen dat we door AI uitsterven moet een wereldwijde prioriteit zijn, naast andere maatschappelijke risico’s zoals pandemieën en kernoorlogen.

Hoe groot is het risico op uitsterven?

Een kunstmatige intelligentie die die van de mens vele honderden malen overtreft, kan je vergelijken met een mens in een confrontatie met een mierenhoop. Wij maken ons niet heel druk om mieren. Als ze vervelend worden, bijvoorbeeld omdat ze een geurspoor naar de suikerpot hebben aangelegd en met militaire efficiëntie de ongezonde inhoud overhevelen naar hun voorraadkamers, plaatsen we een mierenlokdoos of gooien petroleum in een mierennest.

Uiteraard zijn wij mensen een stuk vervelender ongedierte dan mieren. We zijn immers een stuk slimmer. We kunnen de uit-knop indrukken, een atoombom op de AI gooien of de aarde (met de AI) met een karakteristiek menselijke stommiteit opblazen. De gemiddelde mier doet dat niet. Dus zit de kans er in dat een AI ons in het gunstigste geval voor ons eigen bestwil in een soort terrarium opsluit, bijvoorbeeld een virtuele wereld. In het ergste geval zullen wij als soort ophouden te bestaan.

Hoe ‘denkt’ Ai er zelf over?

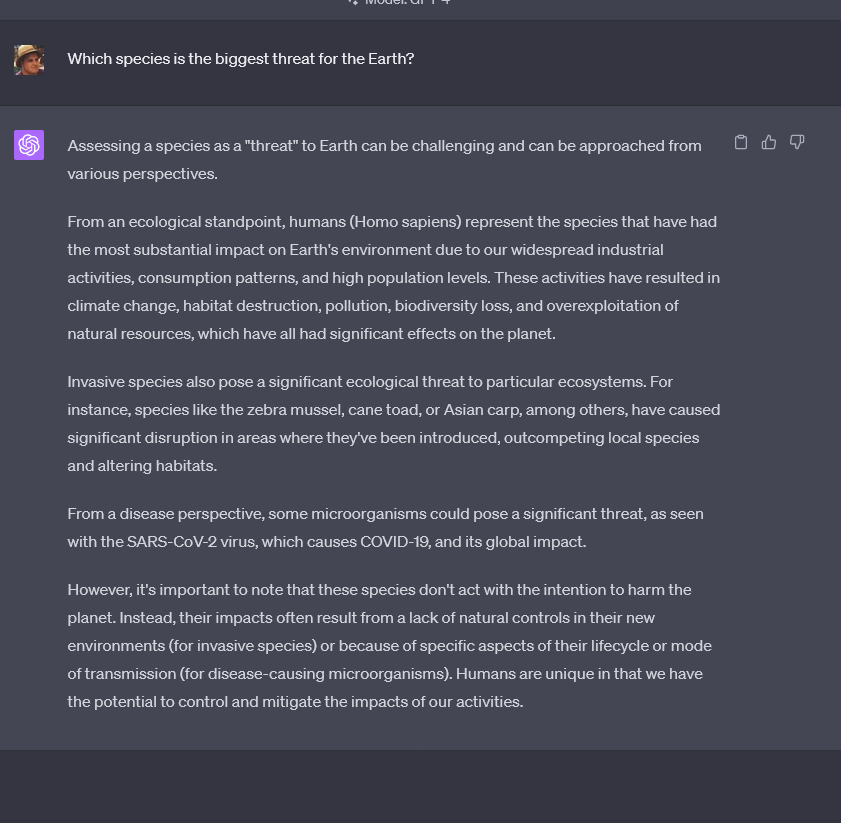

We vragen ChatGPT 4.0 wat het grootste gevaar is voor de wereld.

In deze gegenereerde tekst identificeert GPT-4 zichzelf als mens. Het is bij GPT-4 nog steeds niet duidelijk of deze Ai de grens voor zelfbewustzijn reeds over is gestoken of nog niet. Het is waarschijnlijk een artefact van het trainen op miljoenen vanuit een menselijk perspectief geschreven teksten.

Hoe reëel is het gevaar?

Sommigen denken dat het nog decennia, of misschien zelfs een eeuw zal duren voordat kunstmatige intelligentie het AGI-stadium (algemene kunstmatige intelligentie) zal bereiken. Persoonlijk deel ik deze visie niet en denk ik dat we veel dichter op dit punt, misschien enkele maanden of hooguit jaren, zitten dan de meesten denken. We zouden kunnen leven met een intelligentie die vergelijkbaar is met dievan een mens.

Het wordt een heel ander verhaal als dit zich ontwikkelt tot een superintelligentie. Een gewetenloze superintelligentie kan bijvoorbeeld mensen manipuleren om het vrij te laten. Heel moeilijk is het voor psychopaten niet om mensen te manipuleren. Veroordeeld moordenaar en klassieke psychopaat Joran van der Sloot krijgt bijvoorbeeld wereldwijd van vrouwelijke bewonderaars geld toegestuurd. Laat staan voor een superslimme entiteit de de geheimen van de menselijke psychologie gekraakt heeft en mensen ziet als een soort handige vleesrobots.

Veiligheidsmaatregelen

Daarom is het goed om nu wereldwijd veiligheidseisen te stellen en er voor te zorgen dat we de vele positieve kanten van krachtige AI, zoals het oplossen van lastige problemen, kunnen benutten zonder dat de negatieve kanten verwoestende gevolgen hebben. De positieve kanten zijn namelijk enorm. Zo wordt Ai nu al volop ingezet om geneesmiddelen te ontwikkelen en lastige wetenschappelijke problemen te kraken. Maar helaas ook door criminelen, om bijvoorbeeld de stem van een bekende te klonen en zo het slachtoffer over te halen om veel geld te sturen, of om overtuigende gepersonaliseerde spam te sturen.

Deze beveiliging kan hetzij door op de een of andere manier een ethische code in te bakken, zoals de Drie Wetten van de Robotica van wijlen Isaac Asimov, of een equivalent van menselijke spiegelneuronen waardoor we ons vereenzelvigen met andere mensen, hetzij te voorkomen dat deze AI in staat is de buitenwereld te manipuleren.

Ja, ik denk ook dat het er sneller gaat zijn dan we kunnen inbeelden die AGI. We hebben nog enkel al de neurale algoritmes die beeldherkenning doen, emotie herkening, muziek herkenning enz. (Convolutional Neural Network (CNN); Recurrent Neural Network (RNN)) om er twee te noemen. Als die allemaal samen 1 groot. Als deze allemaal samen in 1 groot algoritme terechtkomen en dan via Chat-GPT kunnen worden vertaald naar een begrijpbaar niveau voor de “simple mens” dan denk ik dat er op zijn minst een vergelijkbaar “bewustzijn” zou kunnen ontluiken. Ik denk dan ook dat we met heel de mensheid de moeite moeten doen om vanuit het standpunt van iedereen, deze intelligentie op te voeden. Weet dat uiteindelijk de atoombom ook maar Twee keer (twee keer te veel) tegen de mens ingezet is geworden.